日期:2026-06-03

版本:0.6.1

日期:2026-04-25

版本:0.11.6

日期:2026-04-20

版本:0.13.5

日期:2026-04-09

版本:0.20.4

日期:2026-03-19

版本:0.18.1

Ollama是一款非常实用的大型语言模型本地化软件,软件界面简洁,操作简单易用,采用的是轻量级框架,不会占用太多的资源,提供了多种命令,方便用户进行模型管理和推理,如查看帮助信息、查看可用模型、拉取模型、删除模型、检查模型状态等,,是一款很不错的软件,对绿色版感兴趣的小伙伴快来下载体验吧!

1、简化部署:

Ollama目标在于简化在 Docker 容器中部署大型语言模型的过程,使得非专业用户也能方便地管理和运行这些复杂的模型。

2、轻量级与可扩展:

作为轻量级框架,Ollama占用资源少,可扩展性好,允许用户根据需要调整配置,以适应不同规模的项目和硬件条件。

3、API支持:

提供了一个简洁的 API,使得开发者能够轻松创建、运行和管理大型语言模型实例,降低了与模型交互的技术门槛。

4、预构建模型库:

包含一系列预先训练好的大型语言模型,用户可以直接选用这些模型应用于自己的应用程序,无需从头训练或自行寻找模型源。

5、模型导入与定制:

从 GGUF 导入:支持从特定平台(如GGUF,假设这是一个模型托管平台)导入已有的大型语言模型。

从 PyTorch 或 Safetensors 导入:兼容这两种深度学习框架,允许用户将基于这些框架训练的模型集成到 Ollama 中。

1、硬件加速和资源优化

GPU加速:在支持CUDA或Metal的设备上,通过GPU可以显著提高推理速度。

资源管理:通过环境变量优化硬件资源的使用(如Olama _ keep _ alive控制模型的内存驻留时间,Olama _ max _ VRAM限制内存占用)。

2、API和多语言支持

RESTAPI:兼容OpenAI接口标准,开发者可以通过/api/generate和/api/chat接口生成文本或实现对话功能。

客户端集成:支持Python、Java、C#等语言调用,方便与其他应用(如Web界面、桌面客户端)集成。

3、本地化部署

Ollama支持在macOS、Linux和Windows(预览版)系统上运行,不依赖云服务,用户可以通过Docker容器或直接安装包进行部署,以确保数据隐私和低延迟响应。

4、模型管理便捷

模型仓库:提供预建的模型库(如Llama3、Phi3、Gemma2等),用户可以通过ollamapull快速下载。

自定义模型:支持通过Modelfile定义模型参数(如温度值、系统提示等),并基于现有模型创建个性化版本,比如可让模型以特定角色(如马里奥)回答问题。

多模型并行:支持同时加载多个模型,通过调整num_ctx参数控制上下文长度。

ollama本地部署需要什么配置?

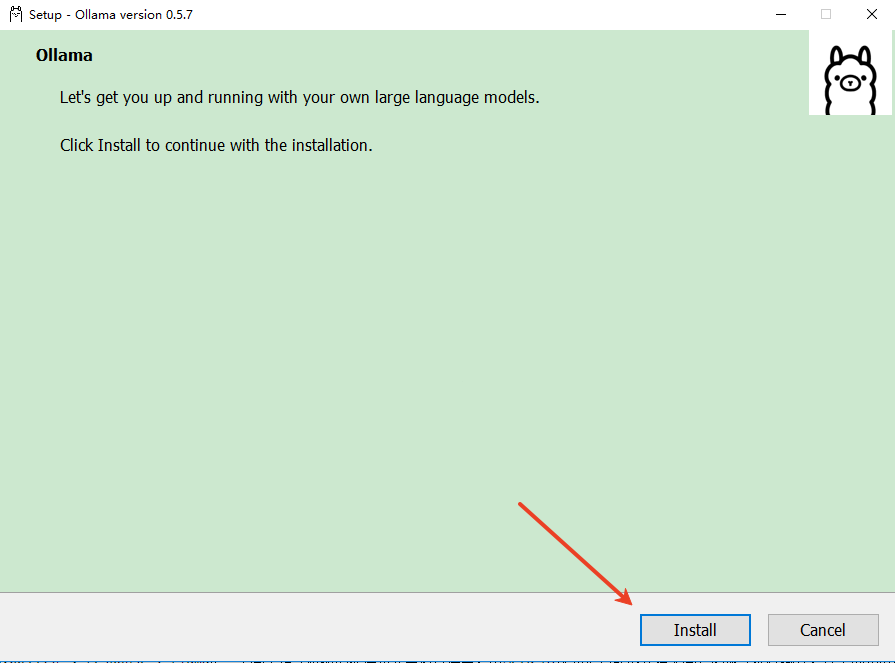

1、解压后,运行ollamasetup.exe,弹出安全警告,点击“运行”。

2、开始安装,点击“install”,片刻后就能安装完成。

1、修复了一些bug。

2、优化了软件性能和界面。

日期:2026-06-03

版本:0.6.1

日期:2026-04-25

版本:0.11.6

日期:2026-04-20

版本:0.13.5

日期:2026-04-09

版本:0.20.4

日期:2026-03-19

版本:0.18.1

ds大模型安装助手官网版

下载

Mockup Creator(程序模型设计工具) 3.4

下载

八宝模型库插件旧版本

下载

FinalMesh(三维模型查看器)v3.2.1.525

下载

《LinpressNX冲模设计软件》最新版

下载

ScreenToGif2.39安装程序x64

下载

腾讯桌面整理经典版

下载

随手写

下载5.79MB

2026-06-02

2.16MB

2026-06-02

30KB

2026-06-01

47.34MB

2026-06-02

17.68MB

2026-06-02

23.20MB

2026-06-02

84.55MB / 2026-03-23

248.80MB / 2026-02-07

2.79MB / 2025-10-16

25.97MB / 2026-04-29

1.90MB / 2026-05-07

210.99MB / 2025-06-09

374.16MB / 2025-10-26

京ICP备14006952号-1 京B2-20201630 京网文(2019)3652-335号 沪公网安备 31011202006753号违法和不良信息举报/未成年人举报:legal@3dmgame.com

CopyRight©2003-2018 违法和不良信息举报(021-54473036)400-105-5185 All Right Reserved

玩家点评 (0人参与,0条评论)

热门评论

全部评论